2024年6月,国内领先的大模型应用kimi携手清华大学madsys实验室,联合发布了基于kvcache的大模型推理架构mooncake。该架构通过pd分离和存算一体化设计,显著提升了kimi智能助手的推理吞吐量,并有效降低了推理成本,x k ^引发业界广泛关注。近日,清华大学、9#aisoft研究组织及阿里云等多家企业和机构正式开源mooncake大模型资源池化项目,旨在构建高性能推理框架的开源生态,邀. o ( { 3 D R请更多厂商和开发者共同参与。

依托清华大学Q O v J A A 9 i创新研究计划(AIR)项目,阿里云与清华大学合作探索大模型资源池化技术在工业界的应用,并取得了丰硕成果。为加速大模型推理技术发展,特别是推理实例共享缓存池化层的标准化,双方深度合作开发Mooncake项目,整合主流大模型推理框架,抽象缓存池化层的底层接口,构建高效的分布式资源解耦架构,并针对大模型场景进行深度优化,提升超长上下文推理性能。

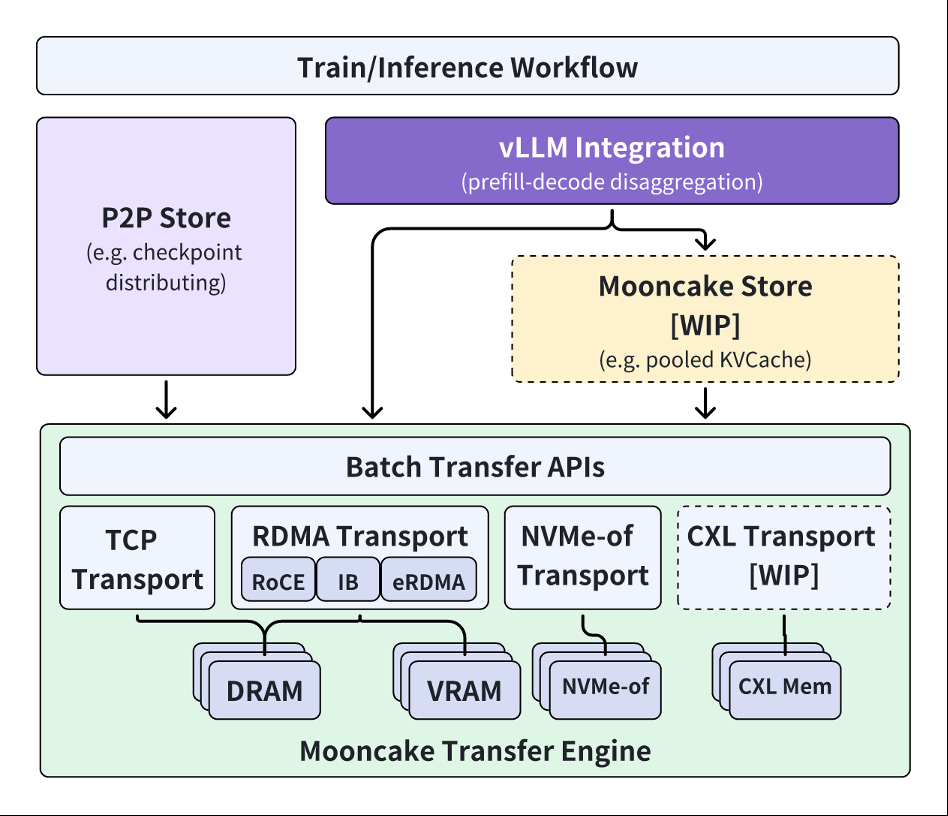

作为AI基础设施提供商,阿里: F e ] & A S云为Mooncake项目贡献了传输引擎(Transfer Engine)、点对点存储(P2P Store)和高| # / 7 q W K { \性能内存存储等关键组件的代码。在推理框架层面,实现了与主流框架vLLM的适配,显著提升了推理性能,并| ~ ` / |为其他框架的对接提供了参考,推动了大模型资源池化技术的落地。阿里云还提供了自研eRDMA网络的底层传输路径,并计划支持CXL,方便用户在云端快速部署。

清华大学MADSys实验室章明星教授指出,Mooncake充分利用AI基础设施中的CPU、内存` * $ @ 5 S + ; C和SSD资源,提升推理速度,并通过资源解耦架构实现不同推理实例间的缓存共享,减少资源浪费。开源Mooncake旨在促进产学研合作,推动大模型推理系统发展。

未来,阿里云将持续深化Mooncake项; + 0 0 \ J M u b目的参与,与更多企业、机构和高校合作,探索更高效的模型推理架构,推动大模型技术普惠B o % ~ ? $ [ } !各行各业。

Mooncake项目开源地址:https://www.php.cn/link/95a372b63ab8641f! $ E ~ a w Y T I092e77acc9bf468c

以上就是官宣开源 阿里云与清华大学共建AI大模型推理项目Mooncake的详细内容!

微信扫一扫

微信扫一扫