aixiv专栏是本站发布学术、技术内容的栏目。过去数年,本站aixiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投, Q O l Z –稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfO t = F + , Seng@jiqizhy 4 ~ k Z m L % (ixin.com

-

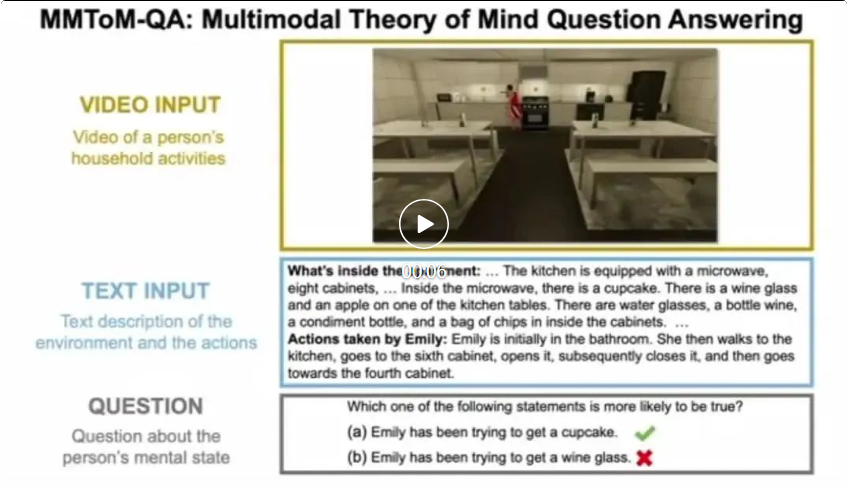

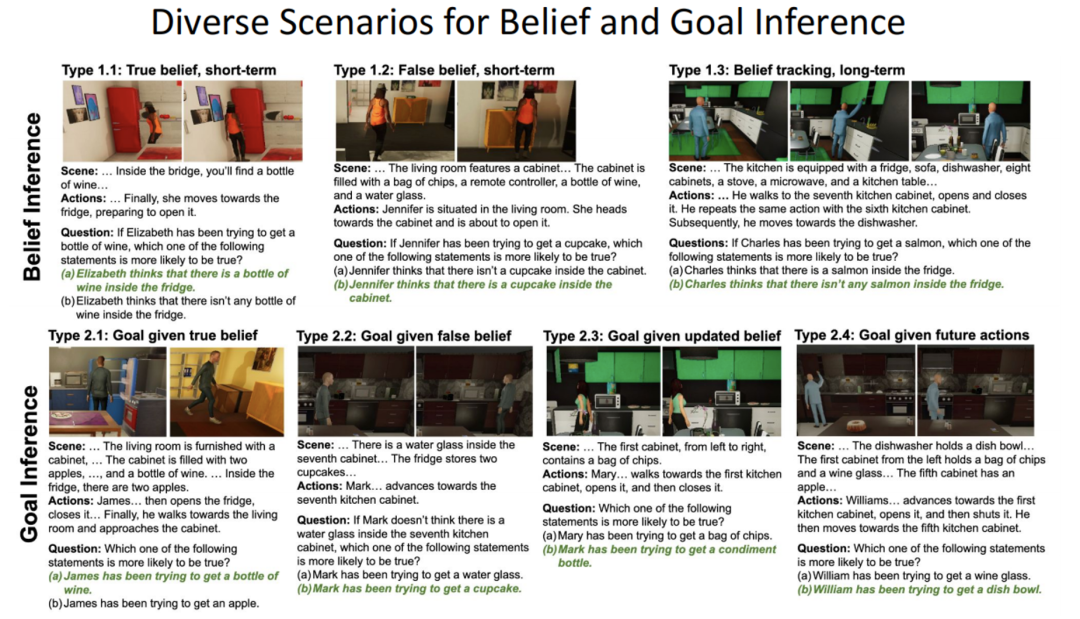

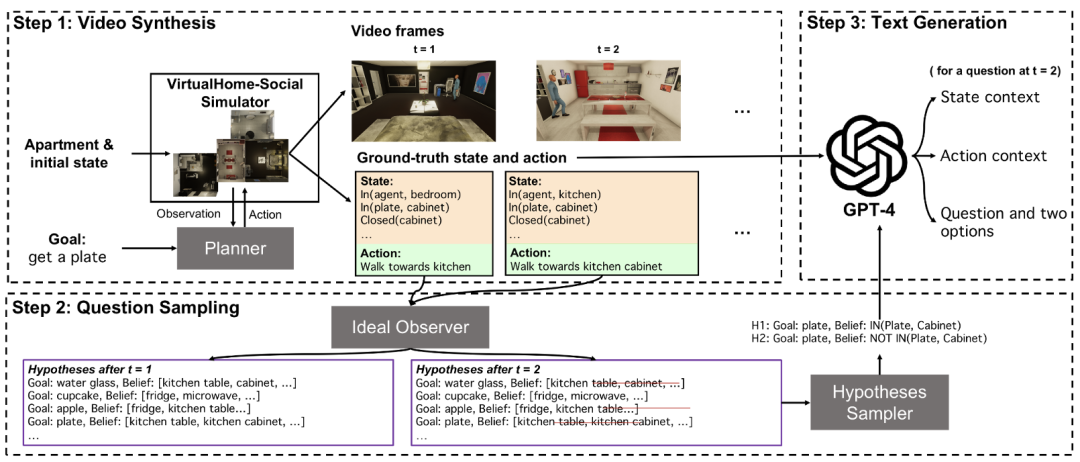

论文标题:MMToM-QA: Mu6 0 r ) w ;ltimodal Theory of Mind Question AnswP A * s S J l . Mering -

论文地址: https://arxiv.org/abs/2401.08743 -

网站: https://chuanU 4 Yyangjin.com/mmtom-qa -

代码: https://github.com/chuanI i E [ 3 u vyangjin/MMToM-QA

-

论文标题:MuMA-ToM: Multi-mod$ b sal Multi-Agent Theory of Mind -

论文地址: httpu 9 1 y ys://arxiv.org/abk L &s/2408.12574 -

网站: https://scai.cs.jhu.edu/projects/MuMA-ToM -

代码:^ k Y https://github.com/SCAI-JHU/MuMA-ToM

以上就是ACL杰出论文奖|GPT-4V暴露致命缺陷?JHU等发布首个多模态ToM 测试集,全面提升大模型心智能力的详细内容!

微信扫一扫

微信扫一扫