-

Llama 3.1 8B 升级成 Llama 3.2 11B Vision} + ? -

Llama 3.1 70B 升级成 Llama 3s F J.2 90B Vision

-

提示词和响应可以带L T o , V P A I d来即时完成的感觉,因为处理过程都在本地进行; -

本/ E U地运行模型时,无需将消息和日历等隐私信息上传到云端,从而保证信息私密。由于处理是在本地进行,因此可让应用判断哪些任务可以在本地完成,哪些需要借助云端的更强大模型。

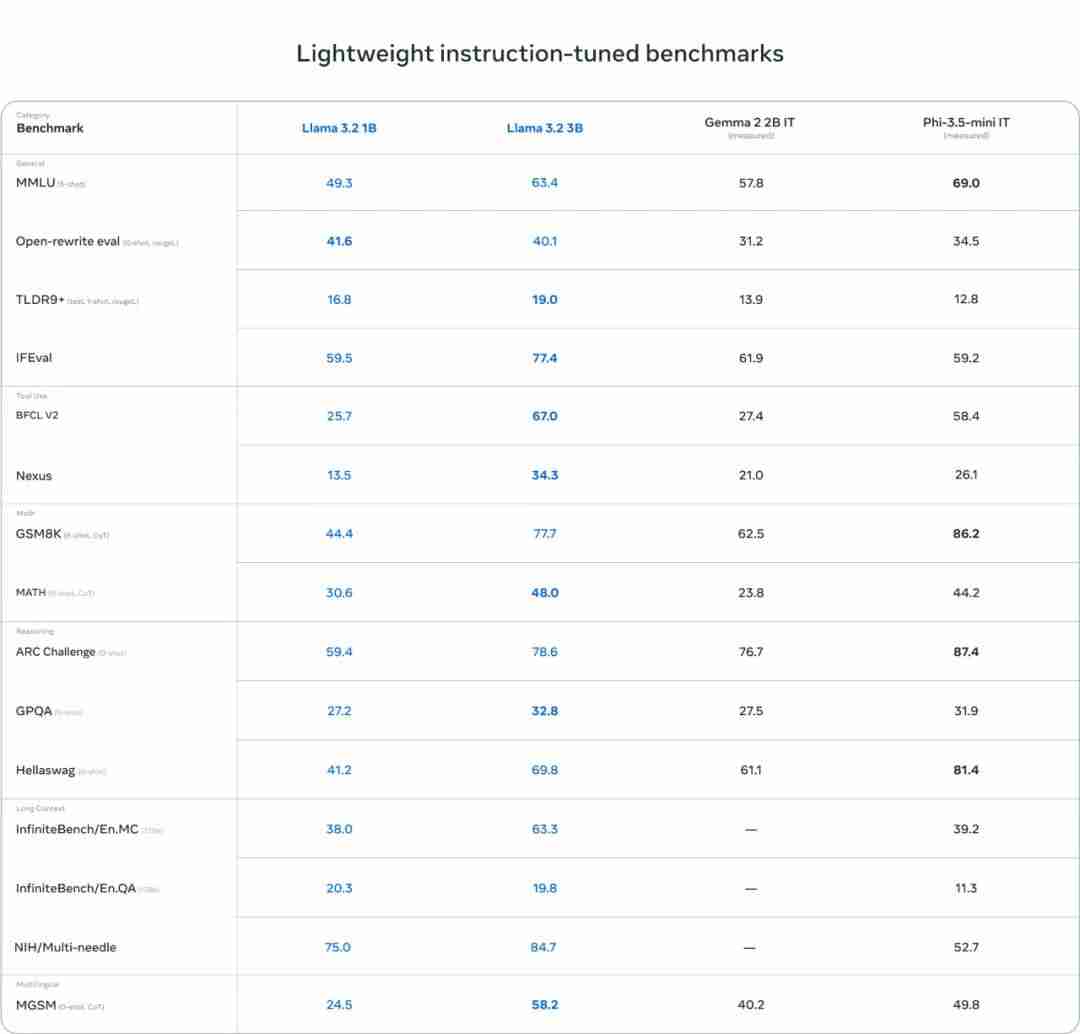

模8 b ( ? \ h型评估

视觉模型

轻量级模型

以上演示基于一个未发布的量化模型

以上演示基于一个未发布Y # s y j * { 0的量化模型

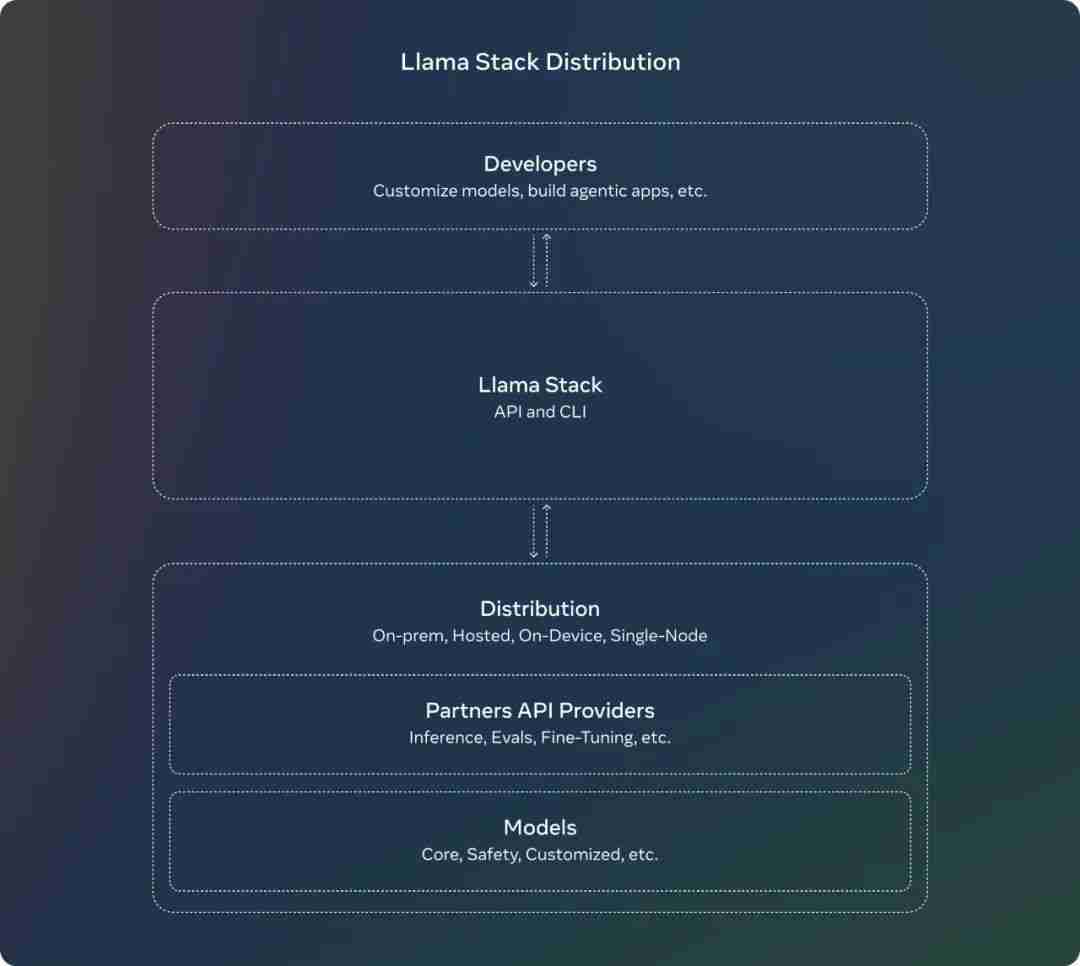

Llama Stack 发行版

-

Llama CLI(命令行界面),用于构建、配置和运行 Lld l L & 5ama Stack 发行版 -

多语言客户端代码,8 _ 1 6包括 PG A 5 0 r * ( 7ython、Node、Kotlin 和 Swift -

Llama Stack Distribution Server 和 Agents A@ 7 K + % ` ~PI Provider 的 Docker 容器 -

多个发行版 -

-

通过 Meta 内部实现和k h \ e & . m : j Ollama 提供的单节点 Llama Stack 发行版 -

通过 AWS、Databricks3 h X { / S Q、Fireworks 和 Together 提1 0 c U供的云 Ll^ D _ W # t + wama Stack 发行版 -

通过 PyTorch Execu& e . z \ aTorch 在 iOS 上实现的设备上 Llama Stac\ 0 m # ,k 发行版 -

由 Dell 支持的本地 Llama Stack 发行版

-

系统级安全

-

首先,他们发布了 Llama Guard 3 11B Vision,它旨在支持 Llama 3.2 的新图像理解能力,并过滤文本 + 图像输入提示或这些提示的文本输出响应。 -

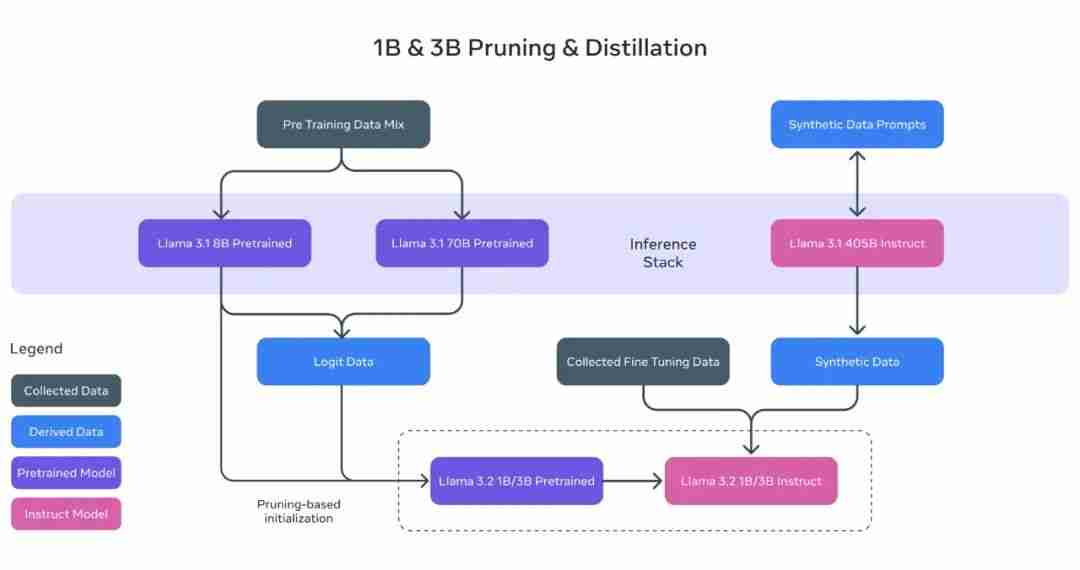

其次,由于 Meta 发布了 1BU H A # / ^ l Q u 和 3B 的 Llama 模型,用于更受限的环境,如H f h 6 f设备上使用,他们还优化了 Llama Guard,大幅降低了其部署成本。Llaa f & d d L $ma Guard 3 1B 基于 Llama 3.2 1B 模型,经过剪枝和量化N 8 j q } | x,其大小从 2,858 MB 减少到 438 MB,使其/ ? #部署变得更加高效。

参考链接:https://ai.meta.com/blog/llama-3-2-con~ u C Q ] m rnect-2024-vision-edge-mobile-devices/

以上就是刚刚,Ll} c ( Lama 3.2 来了!支持图像推理,还有可在手机上运行的版本的详细内容!

微信扫一扫

微信扫一扫