Token

-

用大模型优化大模型预训练数据,节省20倍计算量,实现显著性能提升!

aixiv专栏是本站发布学术、技术内容的栏目。过去数年,本站aixiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工…

-

23亿参数,Transformer架构,NASA、IBM发布「天气+气候」通用AI模型Prithvi WxC

编辑 | KX 9 月 23 日,IBM 与 NASA 合作发布了一个用于天气和气候的新型通用 AI 模型 Prithvi WxC,该模型可以在台式计算机上运行,且开源。 Prit…

-

LLM仍然不能规划,刷屏的OpenAI o1远未达到饱和

实验证明,大模型的 System 2 能力还有待开发。 规划行动方案以实现所需状态的能力一直被认为是智能体的核心能力。随着大型语言模型(llm)的出l Z S现,人们对 llm 是…

-

开源!上海AI Lab视频生成大模型书生·筑梦 2.0来了

aixiv专栏是本站发布学术、技术内容的栏目。过去数年,本站aixiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工…

-

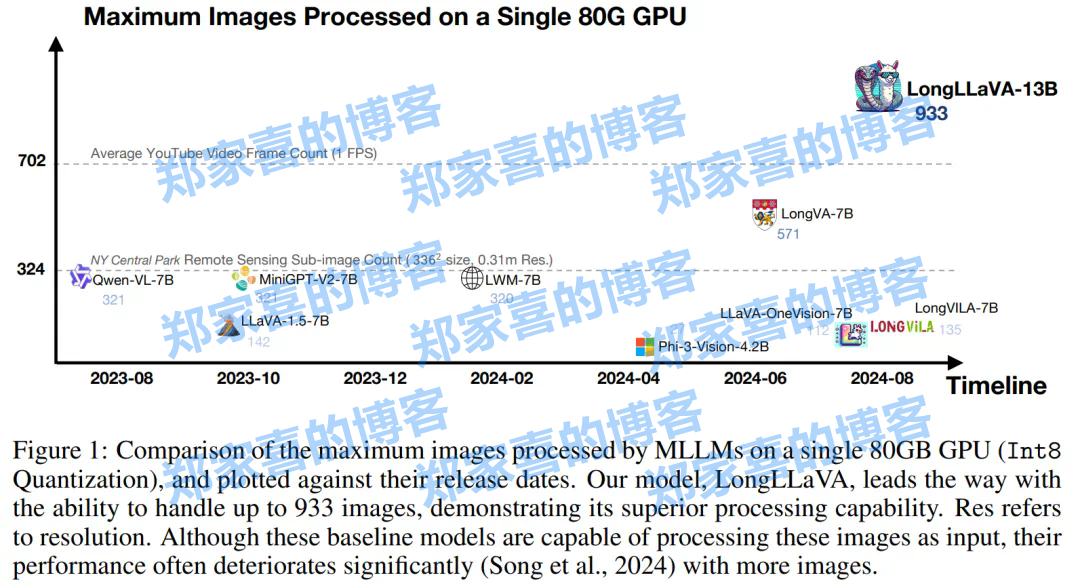

首个Mamba+Transformer混合架构多模态大模型来了,实现单卡千图推理

本文作者来自于香港中文大学深圳和深圳大数据研究院。其中第一作者为香港中文大学深圳博士生王熙栋和研究助理宋定杰,主要研究方向分别为医疗agi和多模态学习;博士生陈舒年研究方向为多模态…

-

CoT能让模型推理能力无上限?田渊栋、LeCun下场反对:两层MLP还能模拟全世界呢

「这相当于在理论上,两层神经网络在理论上可以拟合任何数据,我们就盲目相信并应用在所有场景中。」 大模型新范式 OpenAI o1 一经发布,如何「复刻」出 o1 便成为了 AI 圈…

-

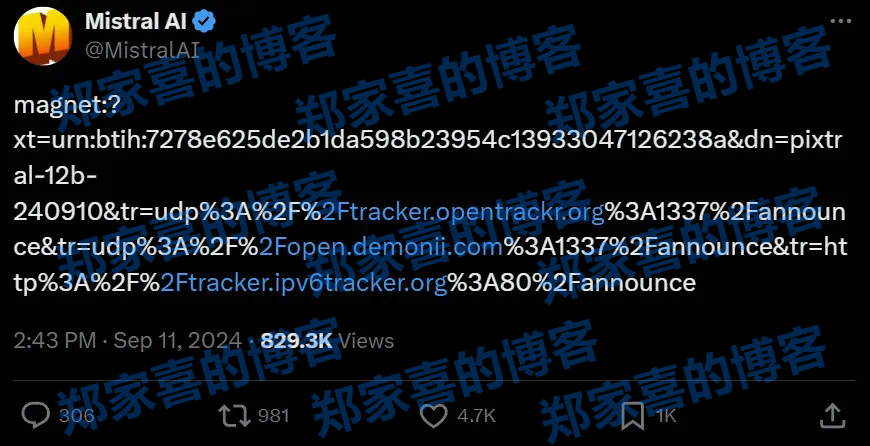

Mistral首个多模态模型Pixtral 12B来了!还是直接放出24GB磁力链接

训练完就直接上模型。 我们都知道,Mistral 团队向来「人狠话不多」。昨天下午,他们又又又丢出了一个不带任何注解的磁力链接。 解析一下这个链接,可以看到大k X + y s D…

-

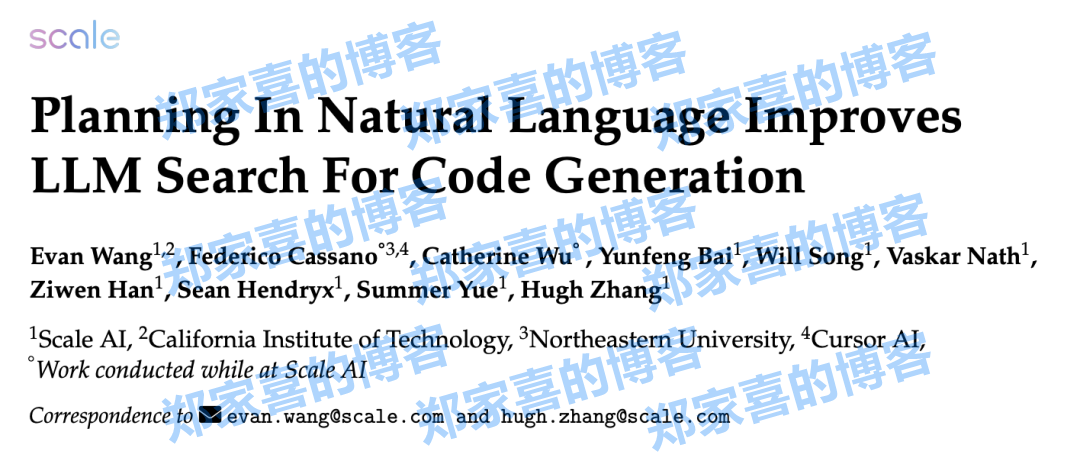

Scaling Law瓶颈,Cursor编程为什么这么强?团队参与新研究掏出秘密武器

近段时间,ai 编程工具 cursor 的风头可说是一时无两,其表现卓越、性能强大。近日,cursor 一位重要研究者参与的一篇相关论文发布了,其中提出T k u j了一种方法,可…

-

让大模型能听会说,国内机构开源全球首个端到端语音对话模型Mini-Omni

AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工…

-

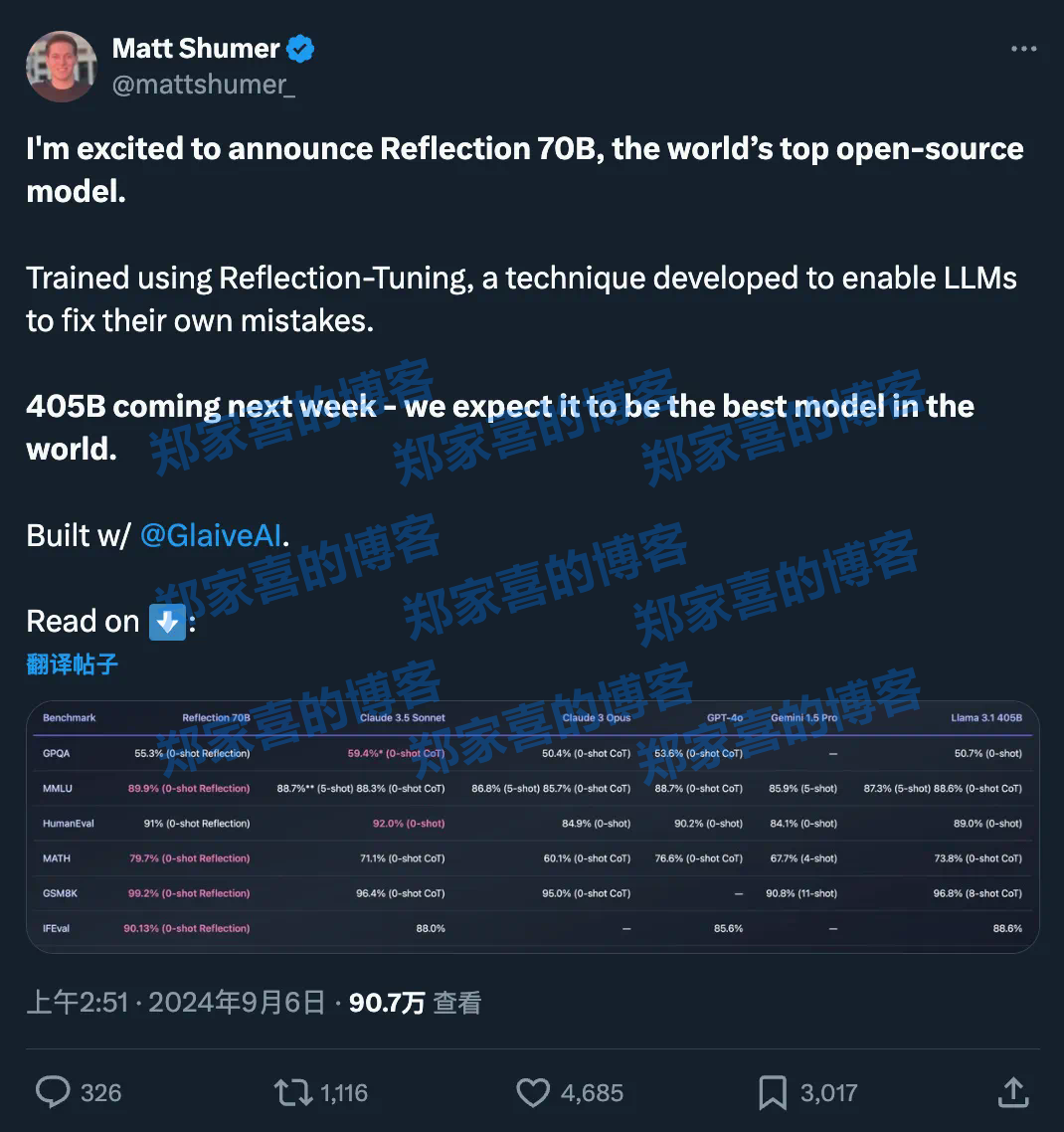

刚刚,开源大模型的新王诞生了:超越GPT-4o,模型还能自动纠错

快速更迭的开源大模型领域,又出现了新王:Reflection 70B。 横扫 MMLU、MATH、IFEval、GSM8K,在每项基准测试上都超过了 GPT-4o,还击败了 405…

-

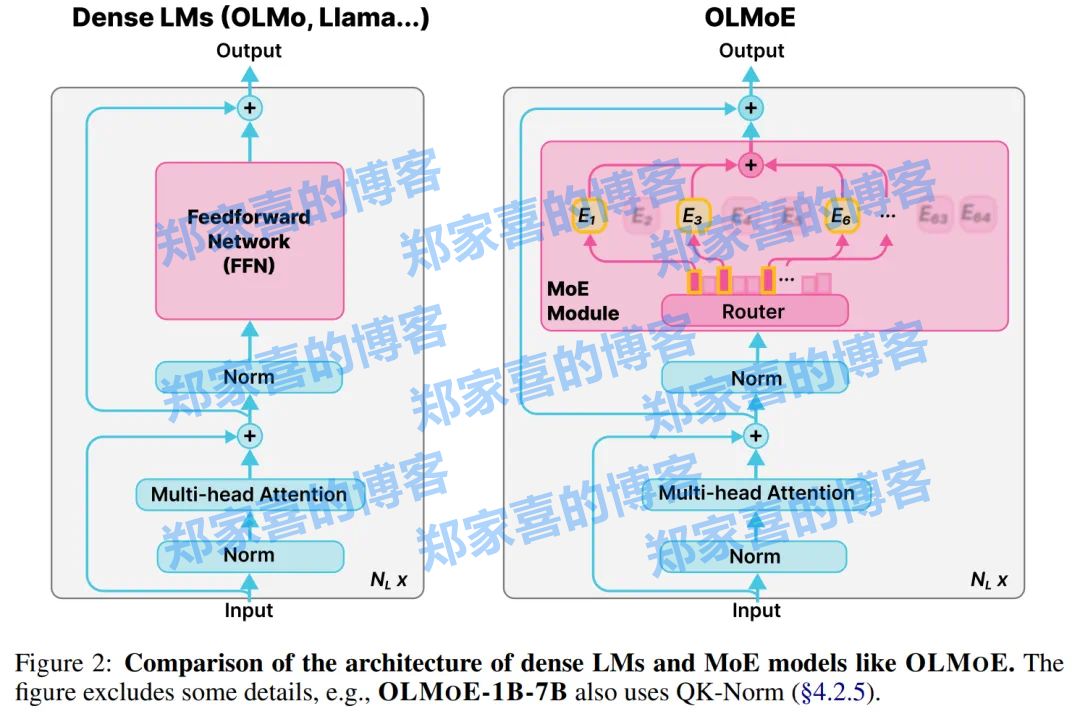

第一个100%开源的MoE大模型,7B的参数,1B的推理成本

训练代码、中间 checkpoint、训练日志和训练数据都已经开源。 尽管大语言模型 (LM) 在各种任务上取得了重大进展,但在训练和推理方面,性能和成本之间仍然需要权衡G P $…

-

支持1024帧、准确率近100%,英伟达「LongVILA」开始发力长视频

现在,长上下文视觉语言模型(vlm)有了新的全栈解决方案 ——longvila,它集系统、模型训练与数据集开发于一体。 现阶段,将模型的多模态理解与长上下文能力相结合是非常重要的,…